Womit hat künstliche Intelligenz angefangen?

In den Anfängen der künstlichen Intelligenz wurden einfache, statistische Modelle verwendet, um einzelne Worte durch Häufigkeiten der Wortkombinationen zu analysieren. Wesentliche Weiterentwicklungen gab es durch neuronale Netze in der zweiten Hälfte des 20. Jahrhunderts, die die Arbeitsweise des menschlichen Gehirns nachahmten und aus Daten lernen konnten. Dadurch wurden die Ergebnisse bei Text & Bildaufgaben im Vergleich mit statistischen Methoden deutlich verbessert. Ein entscheidender Durchbruch kam 2017 mit der Publikation „Attention Is All You Need“ von Google Brain1 mit der Vorstellung von speziellen neuronalen Netzen sog. „Transformern“, die Kontext und Beziehungen in sequenziellen Daten analysieren. Im Gegensatz zu früheren Methoden, die z.B. Wort für Wort einzeln analysieren, betrachten Transformer ganze Textbausteine.

Warum hat die Entwicklung Jahrzehnte gedauert?

Die Antwort auf diese Frage ist komplex. Einer der Gründe ist, dass es mehrere Perioden der Stagnation in der KI-Forschung gab, die als “KI-Winter” bekannt sind. Während dieser Phasen konnten die Forschungsergebnisse nicht mit den steigenden Erwartungen mithalten und die Finanzierung wurde oft gekürzt. Zusätzlich wurden die Modelle immer größer, rechenintensiver und damit teurer.

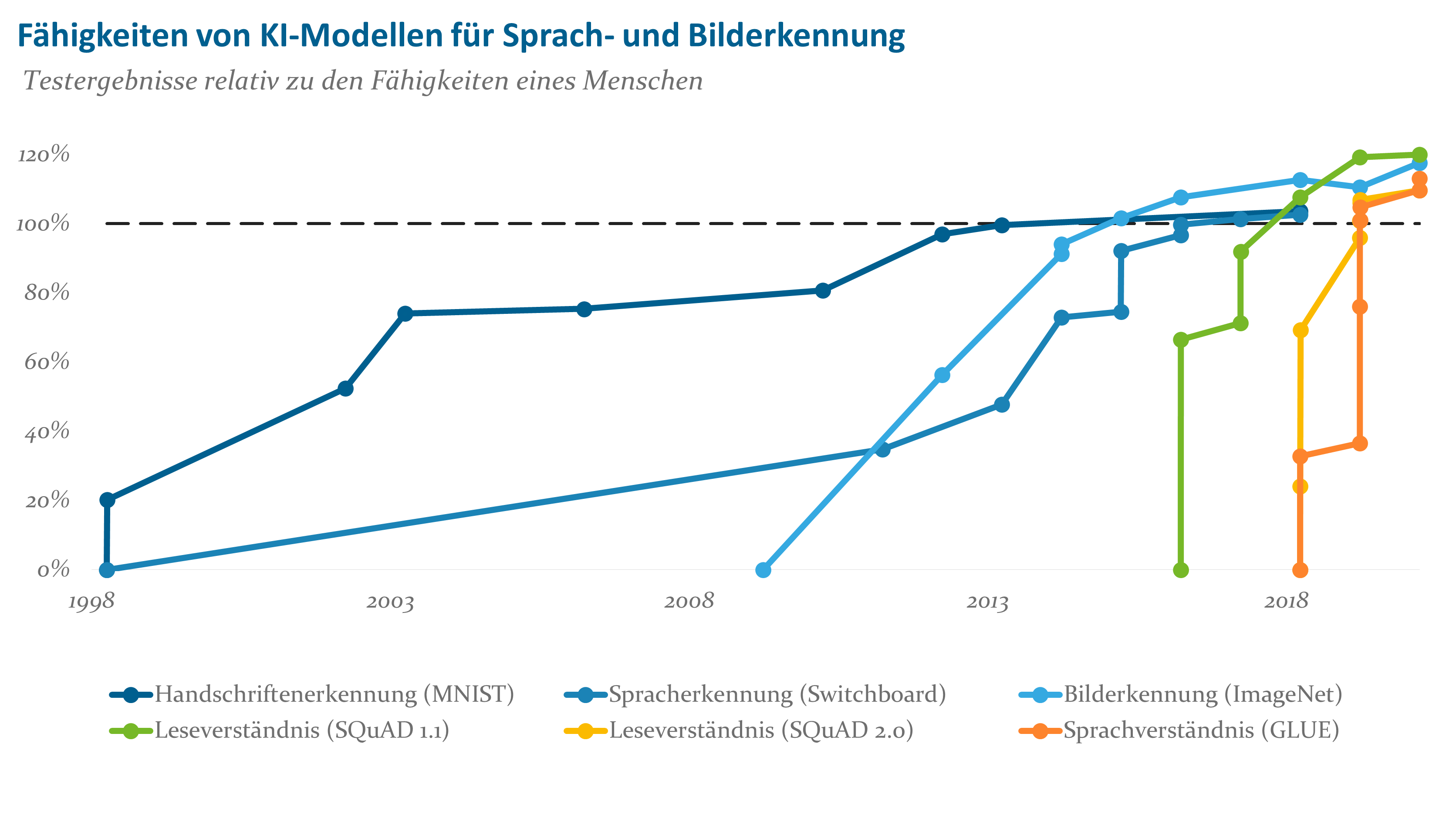

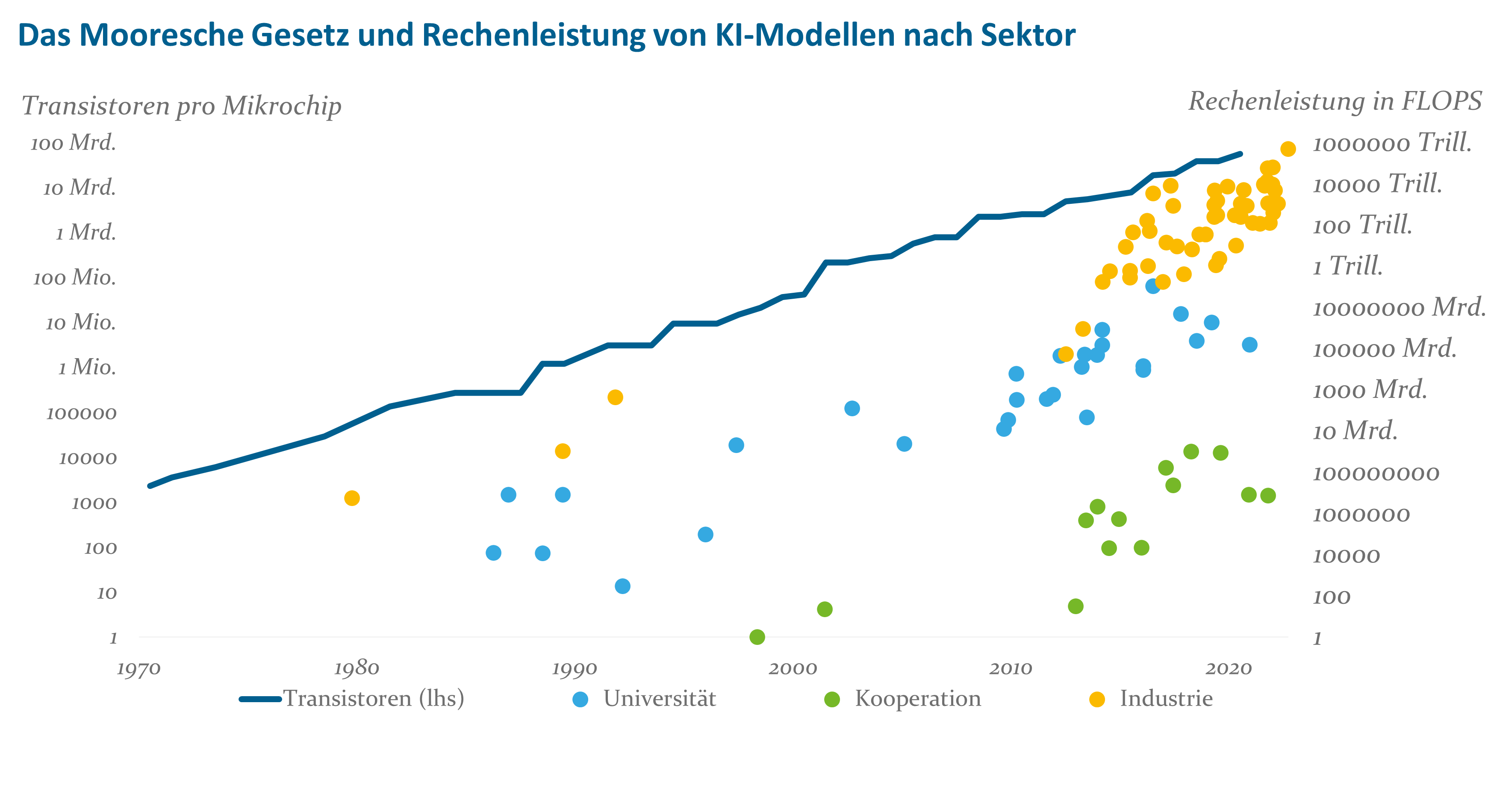

Die Grundlagen für den heutigen Erfolg von KI-Modellen kam von außerhalb. Die Rechenleistung der Computer ist exponentiell gestiegen – ein Phänomen, das als „Mooresches Gesetz“2 bekannt ist. Darüber hinaus hat die digitale Revolution dazu geführt, dass wir mehr Daten als je zuvor generieren und speichern können. Diese beiden Faktoren haben es ermöglicht, immer größere neuronale Netze zu trainieren und Modelle, wie ChatGPT4, zu entwickeln, die über Billionen von anpassbaren Parametern verfügen. Vor wenigen Jahren waren diese Größenordnungen undenkbar. Gleichzeitig wurden damit bei verschiedenen Aufgaben menschenähnliche Ergebnisse erreicht (vgl. Abbildung 1).

Abb. 1: Fähigkeiten von KI-Modellen für Sprach- und Bilderkennung; Quelle: Kiela et al. (2021) – Dynabench: Rethinking Benmarking in NLP

Ist der Anwalt oder Arzt bald eine KI?

Modelle, wie ChatGPT, können viele Aufgaben bewältigen. Diese reichen von der Generierung kreativer Texte bis hin zur Beantwortung von Fragen und der Unterstützung bei der Programmierung. Der Erfolg und das Wachstum von ChatGPT sind beeindruckend: Während der vorherige Rekordhalter TikTok neun Monate benötigte, um 100 Millionen Nutzer zu erreichen, hat das entwickelnde Unternehmen OpenAI dieses Ziel in nur zwei Monaten erreicht3.

Die Qualität von ChatGPT wurde von OpenAI mit verschiedenen Prüfungen getestet und im GPT-4 Technical Report4 veröffentlicht. So war ChatGPT bei der amerikanischen Rechtsanwaltsprüfung besser als ca. 90% der Teilnehmer und hat damit die Grenze zur Zulassung als Anwalt weit übertroffen. Ähnliche Ergebnisse gibt es fachübergreifend bei Universitätsklausuren. Andere haben ChatGPT an der US-Prüfung zur Zulassung als Arzt getestet und ChatGPT hat erfolgreich bestanden5. Daher ist es wenig verwunderlich, dass erste Nutzer schon davon berichten, eigenständig ohne Anwalt mit ChatGPT kleinere Rechtsstreite vor Gericht gewonnen zu haben.

Auch Midjourney (Beispiel in Abbildung 2), eine KI zum Generieren von Bildern, hat bereits Preise in Kunstwettbewerben gewonnen, was zu vielen Kontroversen geführt hatte6.

Quiz: Welches Bild ist echt und welches von Midjourney?

Abb. 2: Key Lime Pie Bars with Graham Cracker Crust; Lösung: Das rechte Bild wurde von Midjourney erstellt7

Die Erstellung von qualitativ hochwertigen Ausgaben erfordert jedoch oft sorgfältiges “Prompt Engineering” – das Erstellen von Eingabeaufforderungen, die das Modell dazu bringen, die gewünschten Ausgaben zu erzeugen. Gleichzeitig sollte man sich einer Regel bewusst sein: “garbage in, garbage out” – schlechte Eingaben führen in der Regel zu schlechten Ausgaben. Es erfordert auch ein gewisses Maß an Übung und Kreativität im Prompt Engineering, um das gewünschte Ergebnis zu erzielen.

Die Auswirkungen dieser Technologien auf den Arbeitsmarkt sind immens. Mehrere Studien, die einen möglichen Produktivitätsschub vorhersagen, wurden bereits veröffentlicht. Das Programmieren mit Hilfe von ChatGPT und anderen KI-Tools, wie zum Beispiel GitHub Copilot, fühlt sich laut einiger Nutzerberichte „fast schon wie Schummeln an“. Viele kleinere Fleißarbeiten und mühselige Aufgaben übernimmt auf einmal die Maschine. Die Ergebnisse sind nicht immer perfekt und bedürfen häufig einer menschlichen Nachjustierung, aber nichtsdestotrotz bleibt in der Gesamtschau durch die Anwendung von generativer KI eine enorme Zeitersparnis.

“The hottest new programming language is English”

Dunkle Wolken am Horizont: Potenzielle Gefahren

Auch wenn es viele positive Dinge im Zusammenhang mit der Technologie gibt, sind auch Gefahren vorhanden. Dabei muss man bedenken: Schlechter wird diese Technologie wohl nicht, nur besser.

“The idea that this stuff could actually get smarter than people — a few people believed that. But most people thought it was way off.

And I thought it was way off. I thought it was 30 to 50 years or even longer away. Obviously, I no longer think that”

Als Anwender gibt es primär das Risiko des „Halluzinierens“. Die Modelle erfinden manchmal Fakten, um die gewünschten Ergebnisse zu erzielen. Sie haben sehr genau gelernt, wie eine korrekte Antwort aussieht. Zum Beispiel wissen sie, wie wissenschaftliche Quellenangaben aussehen. Das Ergebnis sieht aus wie eine korrekte Quellenangabe. Das Buch oder der Autor, die dort genannt werden, hat es aber unter Umständen niemals gegeben.

Gefahren gibt es vor allem durch bösartige Anwender. In Diskussion sind schon seit 2017 sog. „Deepfakes“. Dabei handelt es sich um realistisch wirkende, KI generierte Medien. Im Zusammenhang mit dem russischen Überfall auf die Ukraine, sind einige der Videos als Deepfake bestätigt worden. Mit ChatGPT ist es trivial, menschenähnlichen Text zu generieren, sodass Fakenews, Phishing und Betrugsversuche deutlich schwieriger zu durchschauen sind. Auch mit Video und Ton gibt es solche Fälle: So wurden Familien um viel Geld betrogen, weil am Telefon die angeblich entführte Tochter weinend nach Lösegeld fragte, und dabei gab es keinerlei Zweifel an der Stimme.

Welche Mitspieler gibt es auf dem Markt?

Der Name OpenAI und ChatGPT sind in aller Munde. Microsoft, welche in OpenAI bereits im Jahr 2019 eine Milliarden US-Dollar und im Jahr 2023 noch mal 10 Milliarden US-Dollar investiert haben, nutzen die Technologie von OpenAI zur Integration der Sprachmodelle in ihrer Office Suite via Microsoft Copilot. Dadurch haben Sie ihre Konkurrenz unter Zugzwang gesetzt.

Der Größte ist dabei Alphabet, die mit Google Bard Startschwierigkeiten hatten, aber in einer Pressekonferenz ähnliche Integrationen mit Gmail und Google Docs und auch Anwendungen in Google Maps oder sogar in der Medizin präsentierten. Auch Meta hat ihr eigenes Modell veröffentlicht und weiteres angekündigt. Neben Big Tech gibt es auch Open Source Modelle z.B. von Stability AI, die mit Stable Diffusion im Kunstmarkt für Kontroversen sorgen.

Neben amerikanischen Firmen investiert vor allem auch China viel in die Forschung. So hat Beidu seit 2019 mehrere Modelle vorgestellt und Huawei ist im März 2023 mit dem 1-Billionen Parameter Modell „PanGu-Σ“ mit ChatGPT gleichgezogen.

Generell kann man sagen, dass hauptsächlich die großen Tech Firmen Milliardenbeträge in KI investieren. Es ist anzumerken, dass es in dem Feld sehr große, monetäre Eintrittshürden gibt, welche die Forschung vor allem an Universitäten erschweren. Die benötigten Daten und Rechenleistung moderner KI-Modelle wachsen stark exponentiell und das Training ist somit teuer (siehe Abbildung 3). In einem Massachusetts Institute of Technology Event wurde der CEO von OpenAI gefragt, ob ChatGPT4 mehr als 100 Millionen Dollar kostete. Seine Antwort war nur „es ist mehr als das“.10

Abb. 3: Das Mooresche Gesetz und Rechenleistung von KI-Modellen nach Sektor;

Quelle: Sevilla et al. (2023), OurWorldInData.org/grapher/artificial-intelligence-training-computation-by-researcher-affiliation;

Karl Rupp, Microprocessor Trend Data (2022), OurWorldInData.org/grapher/transistors-per-microprocessor/technological-change

Viele haben auch bereits die Aktienkursentwicklungen der Big Tech Unternehmen gesehen. Der Kurs von Nvidia, deren Technologie einen großen Beitrag zur Beschleunigung des Trainings der Modelle geleistet haben, ist seit Januar 2023 um über 100% gestiegen.

Viele stellen sich die Frage, ob es nicht nur eine Blase ist. Am Ende weiß niemand, welche Namen im nächsten Jahrzehnt den KI-Markt dominieren. Ein Blick auf die Dotcom-Blase zeigt: Am Ende konnten sich viele Unternehmen nicht durchzusetzen und es haben sich neue Mitspieler als heutige Marktführer erhoben.

Fazit:

Wir sind noch nicht bei einer eigenständigen, selbstdenkenden künstlichen Intelligenz angekommen, wie man sie aus Filmen kennt. Dennoch bezeichnen viele die Veröffentlichung von ChatGPT als „iPhone Event“ oder vergleichen sie sogar mit der Einführung des Computers. Steve Jobs sagte „Der Computer ist so wie ein Fahrrad für unseren Geist“. ChatGPT hat dem Fahrrad nun einen Motor gegeben. Die ersten Schritte sind getan und die Entwicklung auf dem Forschungsfeld hat sich in den letzten Monaten unerwartet beschleunigt. ChatGPT und die kommende Integration ähnlicher Tools in bereits vorhandene Workflows zeigen: Die Art, wie wir arbeiten, wird sich weiter verändern. Wie genau dies passiert, zeigt die Zukunft.

Fußnoten:

1) Vaswani, Ashish, et. al. (2017): „Attention is all you need“, arXiv:1706.03762

2) Das Mooresche Gesetz besagt, dass sich die Komplexität integrierter Schaltkreise mit minimalen Komponentenkosten regelmäßig verdoppelt (i.d.R. alle 12-24 Monate). Es ist kein wissenschaftliches Naturgesetz, sondern eine Faustregel, die auf eine empirische Beobachtung zurückgeht.

3) Garfinkle, Alexandra (2023, 2. Februar). ChatGPT on track to surpass 100 million users faster than TikTok or Instagram: UBS. URL: https://finance.yahoo.com/news/chatgpt-on-track-to-surpass-100-million-users-faster-than-tiktok-or-instagram-ubs-214423357.html (Stand: 26.05.2023)

4) OpenAI (2023, 27. März). GPT-4 Technical Report. arXiv:2303.08774

5) Brueck, Hilary und Dr. Kohane, Isaac (2023, 6. April): The newest version of ChatGPT passed the US medical licensing exam with flying colors — and diagnosed a 1 in 100,000 condition in seconds. URL: https://www.insider.com/chatgpt-passes-medical-exam-diagnoses-rare-condition-2023-4 (Stand: 26.05.2023)

6) Jumalon, Genel [@GenelJumalon] (2022, 30. August). TL;DR — Someone entered an art competition with an AI-generated piece and won the first prize. Yeah that’s pretty fucking shitty. [Tweet]. Twitter. https://twitter.com/GenelJumalon/status/1564651635602853889

7) recipebotai (2023, 9. Mai). This time it’s slightly harder. One is Midjourney 5.1, the other is real. Which one is which? URL: https://www.reddit.com/r/midjourney/comments/13cq2wz/this_time_its_slightly_harder_one_is_midjourney/

8) Karpathy, Andrej [@karpathy] (2023, 24 Januar). The hottest new programming language is English. [Tweet]. Twitter. https://twitter.com/karpathy/status/1617979122625712128

9) Dr. Hinton, Geoffrey (2023, 1. Mai). ‘The Godfather of A.I.’ Leaves Google and Warns of Danger Ahead. URL: https://www.nytimes.com/2023/05/01/technology/ai-google-chatbot-engineer-quits-hinton.html (Stand 26.05.2023)

10) Altman, Sam (2023, 17. April). OpenAI’s CEO Says the Age of Giant AI Models Is Already Over. URL: https://www.wired.com/story/openai-ceo-sam-altman-the-age-of-giant-ai-models-is-already-over/ (Stand 26.05.2023)